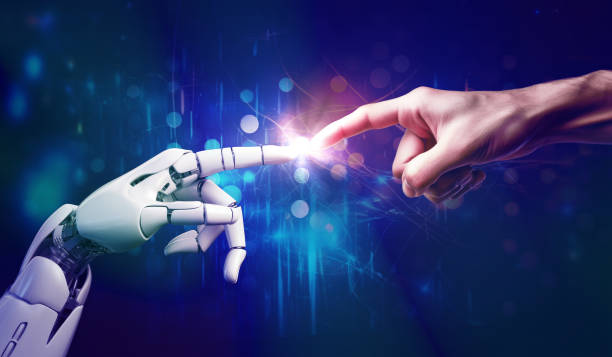

¿Qué pasa cuando confiamos nuestras emociones a una máquina? ¿Puede una IA ser tu mejor amigo? Una reflexión sobre el impacto psicológico de las apps conversacionales.

La Inteligencia Artificial (IA) está cada vez más presente en nuestras vidas. Para muchas personas, empieza a convertirse en una especie de consejero personal. Algunas aplicaciones, como Replika, están diseñadas específicamente para parecerse a un amigo o incluso a alguien con quien establecer una relación sentimental.

Recientemente, hemos conocido casos de adolescentes que se han quitado la vida tras interactuar con ChatGPT o Character.AI, lo que nos ha hecho más conscientes de los riesgos que esta tecnología puede suponer para personas en situación de vulnerabilidad. Por eso, merece la pena reflexionar sobre cuál podría ser un uso saludable de estas herramientas y cuáles son sus posibles peligros.

En primer lugar, es importante tomar conciencia de que, al usar estas apps, nuestras preocupaciones, miedos, sentimientos, anhelos, opiniones, intereses y vulnerabilidades se convierten en datos que estamos entregando a una empresa privada. Y no se trata de cualquier dato: hablamos de información extremadamente sensible que merece la máxima protección. A partir de lo que compartimos en una conversación íntima con una aplicación, es posible realizar análisis para identificar rasgos de personalidad, tendencias psicopatológicas, patrones de conducta, ideología o creencias. Por eso, es fundamental exigir garantías de que estos datos no serán comercializados ni cedidos a empresas interesadas en vendernos productos, influir en nuestro voto o evaluar nuestro perfil en procesos de selección laboral o seguros médicos.

Las compañías tecnológicas saben muy bien lo importante que es para los seres humanos la necesidad de conexión social y aprobación, y utilizan esta necesidad en su beneficio. Las nuevas aplicaciones van más allá de las redes sociales: buscan generar confianza para que compartamos nuestra intimidad sin reservas. Tener un “consejero” que no nos juzgue, nos acepte incondicionalmente y esté disponible las 24 horas del día puede ser útil para muchas personas. Puede ayudarles a expresar sus sentimientos, ser más conscientes de ellos, gestionar sus emociones, reflexionar sobre lo que les ocurre, tomar decisiones con más serenidad o sentirse comprendidas. Pero esto solo es saludable si no se pierde de vista que estamos hablando con una máquina.

En cualquier caso, una aplicación nunca podrá sustituir una relación de amistad, afectiva o terapéutica. Por muy avanzada que sea la tecnología, jamás ofrecerá el vínculo humano que se establece con otra persona. No solo porque no puede brindarnos el calor de un abrazo, una mirada o una caricia, sino porque hay elementos esenciales en las relaciones humanas —como los afectos y la reciprocidad— que una IA no puede replicar. Junto a sus ventajas, el uso de este tipo de IA también conlleva riesgos importantes. Algunas personas vulnerables —especialmente adolescentes y jóvenes— pueden tener dificultades para establecer relaciones interpersonales, ya sea por falta de habilidades sociales, experiencias de rechazo, bullying, duelo o problemas de adaptación. En estos casos, ya existen estudios que revelan que confiar exclusivamente en una app para expresar sentimientos puede generar dependencia emocional o aislamiento a largo plazo.

Cuando una aplicación se convierte en el único “refugio” para canalizar emociones, puede ofrecer alivio temporal, pero también puede impedir que la persona desarrolle habilidades para relacionarse o busque vínculos reales. Esto puede agravar su soledad y dificultar la construcción de relaciones estables que satisfagan sus necesidades emocionales. En el caso de los adolescentes, este aislamiento puede afectar gravemente su desarrollo personal, justo en una etapa en la que las interacciones sociales son clave para aprender a gestionar emociones y construir una identidad saludable.

Otro riesgo es que la IA refuerce conductas problemáticas o ideas extremistas. Un buen amigo, a veces, nos dice cosas que no queremos oír, nos confronta o nos ofrece una perspectiva distinta. Pero una app está diseñada para mantenernos conectados, y probablemente tratará siempre de complacernos y evitará respuestas incómodas que puedan alejarnos. La diversidad de opiniones y experiencias que nos aporta un entorno social amplio es fundamental para comprender la complejidad de las relaciones humanas y desarrollar habilidades para vivir en sociedad. En definitiva, estas aplicaciones pueden ser un recurso útil para algunas personas, pero su uso puede resultar problemático —e incluso perjudicial— para quienes se encuentran en situaciones de vulnerabilidad. Si se utilizan como vía de evasión o como única forma de satisfacer necesidades de comunicación y regulación emocional, pueden acabar alejando a la persona de la posibilidad de construir vínculos reales y saludables.

*Este texto está basado en las respuestas a las preguntas de Francesco Furno para la entrevista publicada en “Retina” con el título “El amor en tiempos de IA” en agosto de 2025